プレスリリース

AI Lab、ヒューマン・コンピュータ・インタラクション分野のトップカンファレンス「CHI 2024」にて主著論文採択

―対話ロボットの遠隔操作者にリアルタイム変換音声フィードバックが与える効果を調査 ―

なお、本研究はムーンショット型研究開発事業の研究プロジェクトの一環として、大阪大学大学院基礎工学研究科の先端知能システム共同研究講座※2による取り組みです。

「CHI」は、ACM (Association for Computing Machinery)の分科会(SIG; Special Interest Group)の1つであるSIGCHI (SIG Computer-Human Interaction)が主催する国際会議で、コンピュータをはじめとする情報システムと人との関わりについて、情報科学・認知科学・心理学・デザイン学など、多岐に渡る分野の研究者や技術者・学生等が世界中から集まる本分野において最も権威あるトップカンファレンスです。

このたび採択された論文「Investigating Effect of Altered Auditory Feedback on Self-Representation, Subjective Operator Experience, and Task Performance in Teleoperation of a Social Robot」は、採択が最も難しいとされる「Full Paper」(口頭発表あり)の論文として採択されており、2024年5月にハワイ・ホノルルで開催される「CHI 2024」での発表を予定しています。

また、本研究に加えてLate-Breaking Workのトラックにて、事前に広告配信効果を予測する「極予測AI」をデザイナーが使いやすくする手法に関する論文※3も採択されております。

*リンク先の論文は4月以降に公開予定です。

■背景

■論文の概要

演技やモノマネ、ごっこ遊びなど、「何者かになりきる」という経験は誰しもが一度は行ったことがあり、その能力が人間には備わっていると考えられます。さらに近年では、バーチャルリアリティ(VR)技術の普及に伴い、バーチャルアバターを用いて、そのキャラクターになりきって活動することもますます一般的になってきています。

こうした「何者かになりきる」ことは対話ロボットを遠隔操作する際にもしばしば求められ、操作者はロボットになりきって発話をします。本研究では、操作者の自己表象を「ロボットになりきる」ように変化させるために、リアルタイム変換音声フィードバック(Altered Auditory Feedback・以下AAF)すなわち発話音声の音響的特徴を変換して発話者にフィードバックする手法※5 に着目しました。

そこで、「ロボットの外見に合わせて音声変換したAAFを操作者に適用することで、操作者の自己表象が『ロボットらしく』変化し、接客タスクが容易になる」という仮説を立て、以下の実証実験を行いました。

●実験内容

大阪府内の小売店(ベーカリー)にて遠隔操作ロボットを1台配置し、実験参加者は実験室からロボットを通じて通行人へ遠隔で接客を行いました。

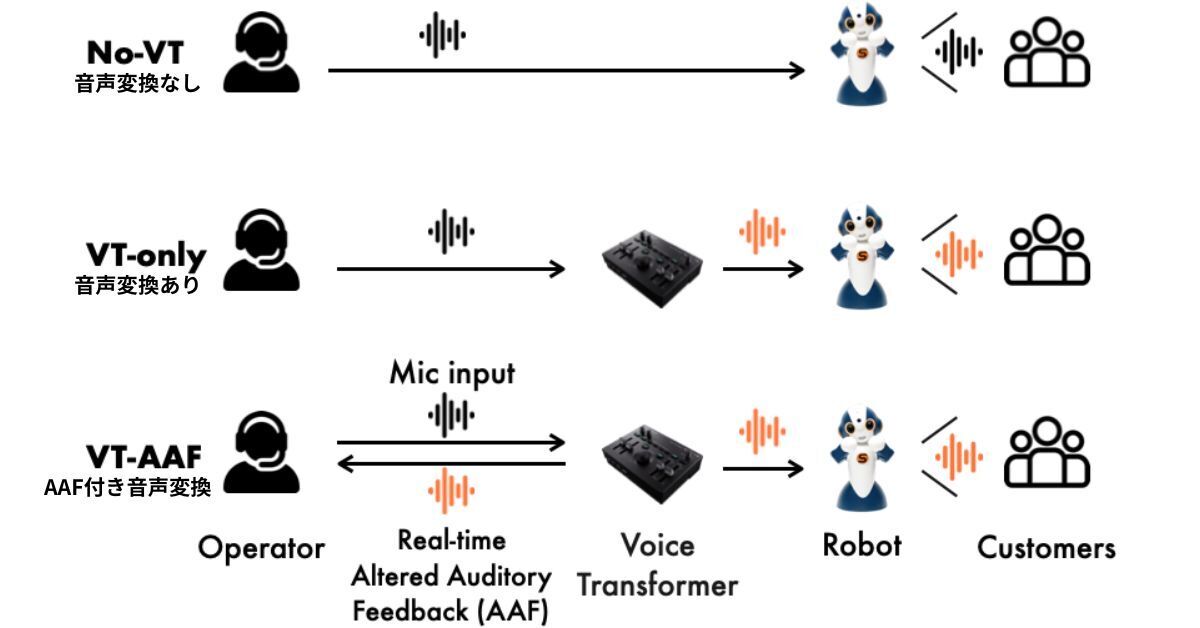

このとき、ロボットから発せられるロボット操作者(実験参加者30名)の音声状況には以下3つの条件があり、各条件下でのロボット操作者の主観的な接客体験や、接客パフォーマンスに与える影響を検討しました。

- 音声変換なし(No-VT)

- 音声変換あり(VT-only)

- AAF付き音声変換(VT-AAF)

| - VT-AAF条件下、すなわちロボット操作者が「ロボットらしく」変換された自己音声のフィードバックを聴きながら接客する条件では、 ・ロボット操作者の自己表象がロボットのキャラクターに合わせて変化した ・ロボット操作者の主観的な遠隔操作体験が改善した ◦「ロボットになりきって接客する」ことが容易になった ◦楽しさやモチベーションなどのポジティブな感情の増加がみられた ‐ 30名の実験参加者のうち26名(87%)の参加者が、3つの音声条件のうちVT-AAFの使用を最も好んだ |

本論文ではこれらの実験結果を踏まえて、対話ロボットの遠隔操作インターフェースのデザインガイドラインを提案しています。

また、対話ロボットの遠隔操作に新たに「自己表象の変化」という観点を取り入れたことも本研究の貢献の一つです。対話ロボットの遠隔操作についてロボット操作者のユーザ体験を改善するという観点に着目した研究はまだ数少なく、本研究ではその重要性が示唆されました。

■今後

本研究では、対話ロボットの遠隔操作インターフェースに関する重要な知見を発見できたと考えています。今回発見した知見をもとに、さらなる実験を行い、ロボットが十分な接客サービスを提供できるために探索してまいります。「AI Lab」は今後も、大学・学術機関との産学連携を強化しながら様々な技術課題に取り組むとともに、「人とロボットが共生できる世界」を目指し、より一層ロボットを含めた対話エージェントによる接客対話技術の研究開発に努めてまいります。

※1 ACM (Association of Computing Machinery) CHI conference on Human Factors in Computing Systems)

※2 先端知能システム共同研究講座

2017年4月1日より発足した、サイバーエージェントAI Labと大阪大学大学院基礎工学研究科石黒浩教授との共同研究講座。人と社会において調和的に関わることができる、ロボットを含めた対話エージェントの実現に向けた基礎技術の確立及び、人の持つ対話能力に関する

科学的な知見の獲得を目指しています。

※3 Shoko Sawada, Tomoyuki Suzuki, Kota Yamaguchi, Masashi Toyoda,

"Visual Explanation for Advertising Creative Workflow"

※4「ムーンショット型研究開発事業」

※5 発話に何らかの音声変調を適用した上で、その変調音声をヘッドホンなどで発話者に聴かせてフィードバックする技術。通常ほぼリアルタイムで用いられ、変調聴覚フィードバックとも呼ばれる。

【本件に関するお問い合わせ先】

株式会社サイバーエージェント AI事業本部 広報

E-mail:cyberagent.ai_pub@cyberagent.co.jp