「生成AI × サイバーエージェント」の基盤を支えるプライベートクラウドエンジニア

サイバーエージェントでは2023年1月、AI事業の根幹である機械学習モデルの大規模化を躍進させる技術への積極投資として、「NVIDIA DGX H100」を国内で初めて導入し、80基の「NVIDIA H100 Tensor コア GPU」を活用したAI開発環境の大幅強化を図ることを発表しました。本プロジェクトをインフラ面から支えたエンジニア2名の話を通じて、サイバーエージェントグループ全体のインフラを支える組織CIU(CyberAgent group Infrastructure Unit)の技術カルチャーをお伝えします。

Profile

-

漆田 瑞樹 (グループIT推進本部 CIU, Software Engineer)

2018 年新卒入社。グループ IT 推進本部 CIU 所属。入社当初はプライベートクラウドの開発・運用を経験。現在はそのクラウドを生かした社内サービスとして Kubernetes + Kubeflow を用いた機械学習基盤、Kubernetes のマネージドサービスの開発に従事。また、2021 年から開発と並行して機械学習基盤のプロダクトマネージャーも務める。 -

高橋 大輔 (グループIT推進本部 CIU, Solution Architect)

2019 年新卒入社。グループ IT 推進本部 CIU 所属。主にプライベートなOpenStackプラットフォームとKubernetes-as-a-Serviceの開発、およびさまざまなアクセラレータデバイス提供における全ての工程を担当。 GPUaaS / AIプラットフォームの基盤となる物理インフラを構築する。

事業の成長に特化したプライベートクラウド環境を作りたい

── お二人のエンジニアとしてのバックグランドを教えてください

漆田:我々はCIU(CyberAgent group Infrastructure Unit)と呼ばれるサイバーエージェントグループ全体のインフラを支える組織に所属しています。

主に、プライベートクラウドである「Cycloud」を運用していて、IaaSとしてのOpenStackやKaaSであるAKEなど様々なサービスを提供しています。パブリッククラウドを利用している事業部のサポートや、動画配信を始めとするスタジオインフラも担当しており、強みであるインフラを主軸に幅広い活動をしています。

高橋:サイバーエージェントは15年以上にわたり社内でデータセンターを運用してきた歴史があり、CIUではハードからソフトウェアまで幅広く対応可能な人材が集まっているのが特徴です。特に最近は、生成AIやセキュリティやコストの面で、プライベートクラウドの注目も高まっているので、事業側からの問い合わせやニーズも増えています。

CIUでは、GPUサーバに関する最先端の機材を調達から導入まで、低コストかつスピード感を持って導入しやすいという側面があります。生成AIや3DCGで活用されるレンダリング環境にも、CIUが構築したGPUサーバが使われています。

また、単にGPUサーバーを提供するだけでなく、 MLパイプラインを構築するためにパブリッククラウドのAI Platform互換のサービス開発をしたりなど、パブリッククラウドの理解や、開発言語やコンテナに精通したエンジニアがいるのがCIUならではの特徴と言えます。

「NVIDIA DGX H100」を国内初導入

── お二人が関わったプロジェクトで、特に印象的だったり裁量権をもってとりくめたプロジェクトを教えてください。

漆田:サイバーエージェントでは今年の1月、AI事業の根幹である機械学習モデルの大規模化を躍進させる技術への積極投資として、「NVIDIA DGX H100」を国内で初めて導入し、80基の「NVIDIA H100 Tensor コア GPU」を活用したAI開発環境の大幅強化を図ることを発表しました。

設備投資やプロジェクト期間としても大規模で、自分にとっても忘れられないプロジェクトです。

「NVIDIA H100 GPU」を導入する事により、「極予測AI」などで活用されるAIと機械学習モデルにおける計算リソースが強化され、画像・テキストの自動生成能力が向上します。これにより、AIと機械学習を活用したサービスが一層高度化し、多様な表現や精度の向上を実現することができます。(※)

今から約2年前にAI事業本部 AI Labの石上 亮介を中心に、ファウンデーションモデル(現CyberAgentLM)の基盤モデル開発プロジェクトが始まりました。CIUでは、2022年いっぱいをハードウェア面の設計に費やし、2023年からソフトウェア開発に集中しました。2023年5月にリリースを迎えましたが、さらなるバージョンアップのため現在も開発は続いています。

※ 極予測AI、大規模言語モデルを活用した広告コピー自動生成機能を実装 ―自社LLM技術およびChatGPTの活用により画像やターゲットを考慮した生成が可能に

── このプロジェクトにおける二人の役割を教えてください

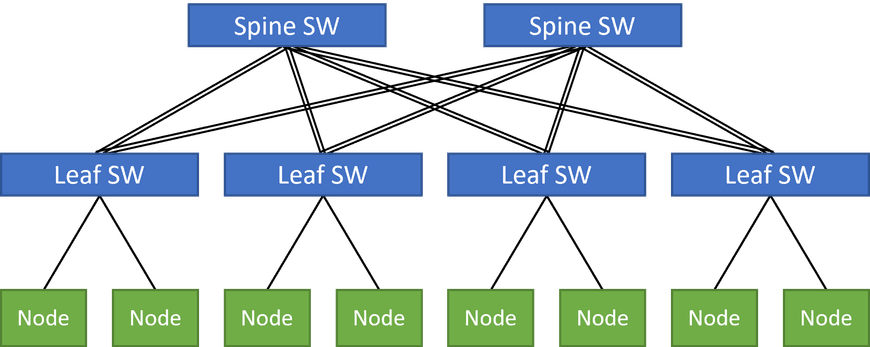

漆田:私は機械学習基盤を構築するためのソフトウェア開発を担当しました。NVIDIA H100向けGPUクラスタ(GPUaaS)のネットワーク構築と、分散学習ジョブ実行のための新サービスである「Distributed」を開発しました。「Distributed」はGPUaaSで実行される分散学習ジョブ実行サービスで、パブリッククラウドでのGPU運用と比べ大幅なコストダウンを実現できました。

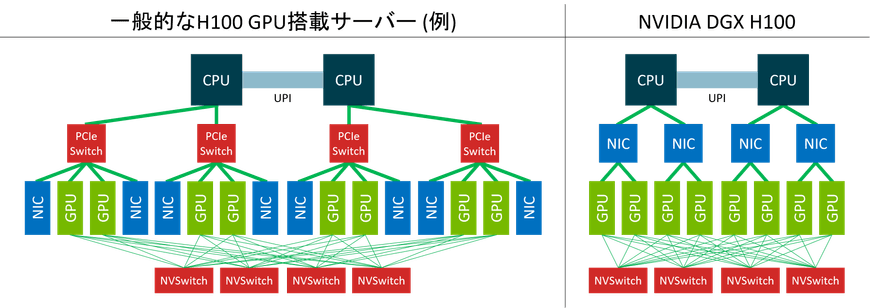

高橋:私はハードウェア面の設計を担当しました。基盤モデル開発に関してハードウェアの要件を策定し、協業先であり「NVIDIA H100 GPU」を開発したNVIDIA様や、ベンダー各社と協力して、機器構成やコストなどを検討し設計しました。

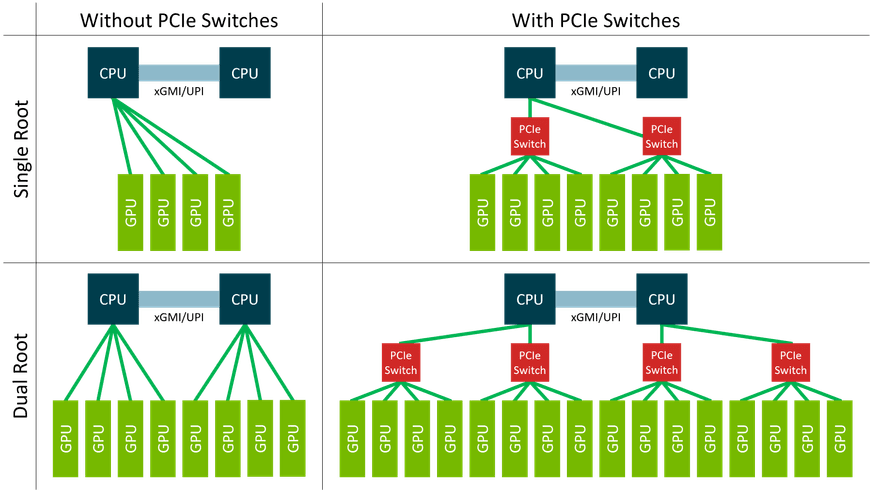

LLMの演算処理は膨大で、1台の計算機での実行を仮定すると、数年かかっても演算が終わらないケースもあります。そこで計算機を並列化する事で、数日から数週間で演算処理を実行するのがセオリーです。並列計算を行う際には、各計算機が進捗状況や計算結果を共有し同期する必要があります。そのため、より効率的な並列化を考慮したネットワーク設計をする必要があります。

AI開発に特化したハードウェア製品である「NVIDIA H100 GPU」ですが、サーバーに挿しさえすれば、事業が要求するスペックを発揮するわけではなく、計算機の並列化における細かなチューニングが必要となります。

我々CIUでは、高性能なGPUサーバーの専有とカスタマイズが可能となっていて、プライベートクラウドを利用する上での大きなメリットとなっています。

── パブリッククラウドのメリットとして、ハードウェアリソースを考慮せずとも、GPUなどのコンピューティングリソースを利用できる点があります。一方、プライベートクラウドではハードウェアの調達から運用まで、リソースの制限があります。サイバーエージェントのLLMの演算処理において、プライベートクラウドが適している理由は何でしょうか?

漆田:パブリッククラウドの活用で、計算機のスケールアップ/スケールアウトが容易ではありますが、従量課金を含めたコストコントロールが必要になります。予め決められたスペックのサーバーを事前予約することで割引を発生させてコストを下げるプランもありますが、LLMのような最先端技術の検証や立ち上げフェーズでは、事業ニーズが急激に高まるなど、中長期的な利用状況が見通せないケースもあります。

AI事業本部をはじめとしてプロダクトでAIを導入するケースが多く、社内需要が高いのでオンプレミスで調達し、プライベートクラウドとして提供した方がコストパフォーマンスが良いのが現状です。

特にAI Labでは研究が活発なので柔軟に対応できるプライベートクラウドの利点が活かせています。

高橋:またGPUに関しては、パブリッククラウドでも払い出すためのリソースが枯渇するケースも起きています。日経新聞で「NVIDIAのGPUサーバーが確保できない」AI企業が悲鳴」という記事が出ていましたが、「NVIDIA H100 GPU」の需要は逼迫しています。

我々CIUの役割として、AI事業本部のビジネス拡大に伴走する形で「NVIDIA DGX H100」をはじめとしたコンピュータリソースを、事業のニーズに合わせて柔軟に調達・提供する事にあります。

技術的好奇心が「生成AI × サイバーエージェント」の基盤を支える

── このプロジェクトでチーム開発する際に重視していた事は何ですか?

漆田:チームとして「サイバーエージェントが取り組む AI 開発のパフォーマンスを最大化する」という目標を持っていて、高橋がハードウェア、私がソフトウェアなど、得意分野で役割を決めながらも、チーム全体では職種の垣根を作らないように心がけていたのが特徴です。

理由として、高性能なハードウェアである「NVIDIA DGX H100」の性能を最大限に活かすには、ソフトウェア担当者もハードウェアの特性や仕様を理解する必要があるからです。同様にハードウェア担当者も、MLエンジニアが使用しているLLMやフレームワークについてどんな用途で活用し、ハードウェア側にどんなパフォーマンスを求めているのかを把握する必要がありました。

高橋:このプロジェクトでは職種や役割の相互理解が必須でしたよね。

LLMのようなマシン性能が求められる処理の場合、ハードウェアとソフトウェアの歯車のような組み合わせがかみあうと、最大パフォーマンスを発揮して効率的なデータ処理や高性能を実現できるのが特徴です。

「NVIDIA H100 GPU」に関しては、ドライバーのバージョンや機械学習フレームワークのバージョンを僅かにでも変更すると、特定のケースでマシン性能が数%低下する現象が起きていました。しかし、ドライバーのバージョンによっては、微妙な効率の違いが生じ、それが微妙に歯車の噛み合わせに合わないと、予期しない性能劣化が生じる可能性もあります。利用する側であるMLエンジニアが「昨日と今日で検証結果が微妙に異なる」と感じてしまうような結果にならないよう、常に品質基準をクリアするよう努力しています。

漆田:ドライバーの更新1つとっても、機械的に検証して更新してしまうのと、MLエンジニアがどういうパフォーマンスを求めているのかを知った上で検証して更新するので、結果は違ってきますよね。職種の垣根がない事で、チームの一体感がうまれ、そういったリスクを見逃さなくて済んだことが多々ありました。

例えるなら、F1などのモータースポーツでレースマシンを組み上げて、コンマ1秒のスピード向上を目指すメカニックチームのような感覚でしたね。

高橋:まさにそんなチームでしたよね(笑)。MLエンジニアと定期的に会話しながらやれた。まさに垣根がないチームでした。

── CIUではインターンや中途採用を積極的に受け入れています。どんな方と一緒に働きたいですか?

高橋:幅広い好奇心を持つ人と一緒に働きたいです。例えば「機械学習基盤に関する知識を持ち、インフラの運用経験があり、ソフトウェアも開発できる・・・」なんて人材はほとんどいませんよね。一人で何でもできる技術者というよりも、自分の得意分野の技術を高めながらも、ハードウェアやネットワーク、機械学習といったジャンルに幅広く興味を持ってくれる人が、CIUに向いていると思います。

漆田:幅広い好奇心はCIUでは本当に役立ちますよね。私自身はソフトウェアエンジニアなので、機械学習についてはもともと詳しくありませんでしたが機械学習基盤の立ち上げとともに ML エンジニアの仕事に興味を持つことで、今では彼ら彼女らと対等に会話をし、それを基盤の仕組みに還元することができています。専門分野でなくても、プライベートクラウドのユーザーの仕事に興味や関心をもっておく必要があると思います。

高橋:CIUは好奇心が強い人が多いですね。チーム内には各種無線従事者資格を趣味として持っている人が多数いますし、電子工作が好きでデータセンターに管理用のガジェットを組み込んでいる人もいます。一見すると仕事と関係なさそうな事でも、技術課題の解決に俯瞰的な視点を持つことで役に立つのではないかと感じます。

あとは、ユーザーのことを考えられる人に来てほしいなと思います。やっぱり、プライベートクラウドのサービスを利用するのはサイバーエージェント社員ですので、ユーザーファーストで考えられる人材を求めています。サイバーエージェント社員は勉強会や懇親会で「こんなことができないのか」といった質問を受けることがあるため、対話力も求められますね。

── 生成AIのニーズや可能性が広がる中、CIUは組織としてどういう姿でありたいですか?

高橋:サイバーエージェントグループ全体では、業務の効率化や生産性向上を目指して「AIオペレーション室」を設立しました。全社員を対象として、生成AIのリスキリングカリキュラムも実施予定なので、今後は社内でのLLMやGPUの需要が増えていき、CIUのプライベートクラウドに求められる事も増えていきます。

また、ゲーム事業ではゲーム生成AI技術の研究を強化、ゲームの新しい開発プロセスとユーザー体験の構築を目指した「ゲームAI Lab」を設立していて、我々CIUも事業部向けにヒアリング等を行っています。今後は、事業やサービスに特化したLLMやモデルのファインチューニングを行い、より事業やサービスに生成AIを活用するケースが増えていくはずです。そのようなニーズにしっかりと対応できるようにしたいと考えています。

漆田:事業固有のニーズは確実に増えていきそうですね。加えて、リスキリングセンター主導で全社員・全職種を対象とした「生成AIのリスキリング」カリキュラムも進行中なので、社員一人ひとりのニーズも活発化していく事が予想されますよね。

今回CIUは「NVIDIA H100 GPU」導入プロジェクトでAI事業本部のビジネス拡大に伴走する様にハードウェアとソフトウェアでサポートしてきました。それと同じように、サイバーエージェントの事業や社員の成長に伴走するような組織でありたいと思っています。

オフィシャルブログを見る

記事ランキング

-

1

Cypicとサイバーエージェントが描くアニメづくりの展望―両社リーダーが語...

Cypicとサイバーエージェントが描くアニメづくりの展望―両社リーダーが語る、新体制での挑戦

Cypicとサイバーエージェントが描くアニメづくりの展望―...

-

2

「ABEMA」が次世代クリエイターと挑む、新しいアニメ創出の形

「ABEMA」が次世代クリエイターと挑む、新しいアニメ創出の形

「ABEMA」が次世代クリエイターと挑む、新しいアニメ創出の形

-

3

発足4年目のTech DE&I プロジェクトが紡ぐ、女性エンジニアの新...

発足4年目のTech DE&I プロジェクトが紡ぐ、女性エンジニアの新たな繋がり

発足4年目のTech DE&I プロジェクトが紡ぐ、女...

-

4

「顔採用ですか?」「採用基準を教えてください」など・・ よく聞かれる質問10...

「顔採用ですか?」「採用基準を教えてください」など・・ よく聞かれる質問10選に人事マネージャーがお答えします

「顔採用ですか?」「採用基準を教えてください」など・・ よく...

発足4年目のTech DE&I プロジェクトが紡ぐ、女性エンジニアの新たな繋がり

当社では、2023年1月に「Tech DE&I プロジェクト」を発足し(参照:「多様性を受容する開発組織には、社会を変える力がある。『Tech DE&I プロジェクト』始動。」、Tech DE&I Lead 神谷を中心として社内外における様々な取り組みを力強く推進してきました(参照:「『あなたならできるよ、と背中を押す大人を増やしたい』Waffleと歩む、IT業界のジェンダーギャップ解消への道のり」)。

2024年に当プロジェクトにサブリーダーとして参画した「ABEMA」エンジニアリングマネージャー 茅野に続き、発足3年目となる2025年には運営コアメンバーとして新たに源間、志葉がジョイン。体制がより強固になったことで、さらに組織の推進力が増し、IT業界ならびに当社の開発組織におけるジェンダーギャップ解消に積極的に取り組んでいます。茅野、源間、志葉にこの1年間の取り組みや今後のビジョンを聞きました。